Investigadores de la Universidad de Texas en la Escuela de Ingeniería Cockrell de Austin han creado los primeros transistores hechos de Siliceno, el material de silicio más delgado del mundo. Su investigación promete construir chips de computadora mucho más rápidos, pequeños y eficientes

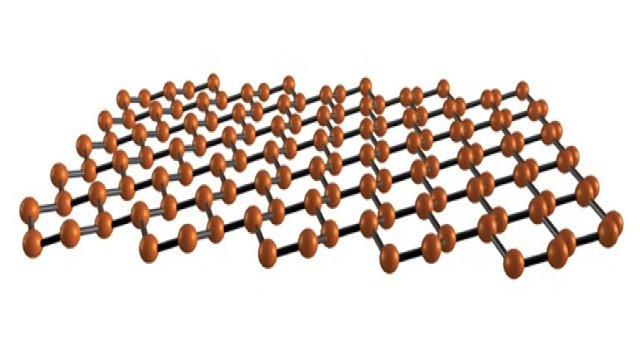

Hechos de una capa de silicio de un átomo de espesor, el siliceno tiene excelentes propiedades eléctricas, pero hasta ahora ha sido difícil producirlo y trabajar con él.

Deji Akinwande, profesor asistente en el Departamento de Ingeniería Eléctrica y Computación de la Escuela de Cockrell, y su equipo, incluyendo el investigador principal, Li Tao, resolvieron uno de los principales desafíos que rodean el siliceno, demostrando que se pueden hacer transistores, dispositivos semiconductores utilizados para amplificar y conmutar señales electrónicas y energía eléctrica.

Los novedosos dispositivos desarrollados por Akinwande y su equipo sobre el más delgado de los materiales semiconductores, un sueño de larga data de la industria de los chips, podrían allanar el camino para las futuras generaciones de chips de computadoras más rápidos y de menor consumo. Su trabajo fue publicado esta semana en la revista Nature Nanotechnology.

Hasta hace unos años, que el hombre pudiese hacer siliceno era materia puramente teórica. Observando el grafeno, a base de carbono, otro material de un átomo de espesor que es promisorio para el desarrollo de chips, los investigadores especularon que los átomos de silicio podrían estructurarse de una manera muy similar.

Akinwande, que también trabaja con transistores de grafeno, ve valiosa la relación del siliceno con el silicio, un material con el que los fabricantes de chips ya saben trabajar.

«Aparte de la introducción de un nuevo jugador en el campo de juego de los materiales en 2D, el siliceno, con su estrecha afinidad química con el silicio, implica una oportunidad en la hoja de ruta de la industria de los semiconductores», dijo Akinwande. «El gran avance aquí es la fabricación eficiente a baja temperatura y la fabricación de dispositivos de siliceno por primera vez.»

A pesar de su promesa de una adaptación comercial, el siliceno ha demostrado ser extremadamente difícil de producir y trabajar debido a su complejidad y su inestabilidad cuando se expone al aire.

Para evitar estos problemas, Akinwande se asoció con Alessandro Molle en el Instituto de Microelectrónica y Microsistemas en Agrate Brianza, Italia, para desarrollar un nuevo método para fabricar el siliceno, que reduce su exposición al aire. Para empezar, los investigadores dejaron que un vapor caliente de átomos de silicio se condensara en un bloque cristalino de plata en una cámara de vacío. Se forma entonces una hoja de siliceno en una capa delgada de plata y se añade una capa de nanómetros de espesor de alúmina en la parte superior. Debido a estas capas de protección, el equipo pudo desprenderlo con seguridad de su base y transferirlo con la plata hacia arriba sobre un sustrato oxidado de silicio. Luego pudieron raspar suavemente algo de la plata, dejando dos islas de metal como electrodos, con una tira de siliceno entre ellos.

En un corto plazo, Akinwande seguirá investigando nuevas estructuras y métodos para crear siliceno, lo que puede llevar a chips digitales de computadora de baja energía y alta velocidad.

Publicación de Referencia: Li Tao, Eugenio Cinquanta, Daniele Chiappe, Carlo Grazianetti, Marco Fanciulli, Madan Dubey, Alessandro Molle, Deji Akinwande. Silicene field-effect transistors operating at room temperature. Nature Nanotechnology, 2015; DOI: 10.1038/nnano.2014.325

Fuente: Science Daily. Aportado por Eduardo J. Carletti

Más información:

- Por qué IBM ha creado un transistor líquido

- Transistor sináptico aprende mientras computa

- Transistores de triple modo de grafeno muestran su potencial

- Crean un transistor óptico molecular

- Convirtiendo puntos cuánticos en transistores espintrónicos

- Ingenieros de EEUU construyen la primera computadora de nanotubos de carbono

- Vislumbrando el computador atomtrónico